Apple, modelos de IA y el código abierto: ¿una revolución controlada?

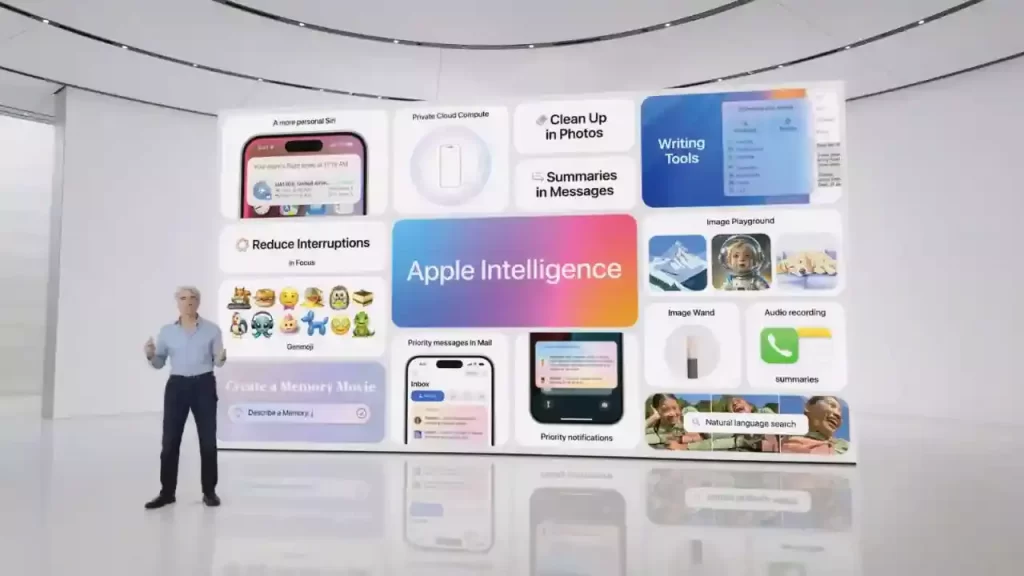

Qué es Apple Intelligence y cómo se integra en el ecosistema

Apple Intelligence es la gran apuesta de la compañía de Cupertino por ingresar a lo grande en el mundo de la inteligencia artificial generativa. A diferencia de sus rivales, Apple ha decidido integrar esta tecnología directamente en sus sistemas operativos iOS 18, iPadOS 18 y macOS Sequoia— bajo un enfoque muy característico: la privacidad como estandarte y una integración total con el ecosistema Apple.

La propuesta incluye funciones como generación de texto, respuestas inteligentes en Mail, mejoras automáticas en fotos, e incluso un Siri completamente renovado y asistido por IA. Todo esto, respaldado por lo que Apple denomina “procesamiento en el dispositivo”, que asegura que gran parte de la información del usuario no salga de su terminal.

Esta estrategia ha sido recibida con entusiasmo moderado. Y es que si bien se nota el avance técnico, el sentimiento general —incluyendo mi experiencia personal— es que la introducción de Apple Intelligence no ha sido la revolución que se esperaba. Apple llega tarde, y aunque llega fuerte, lo hace con cautela.

¿Por qué Apple evita el código abierto en sus modelos de IA?

Mientras empresas como Meta y Google apuestan por modelos de IA abiertos (LLaMA y Gemini respectivamente), Apple ha optado por mantener su tecnología cerrada. ¿Por qué?

Según declaraciones oficiales y reportes como el de Hipertextual, Apple justifica esta decisión principalmente en términos de seguridad, control de calidad y privacidad del usuario. Su argumento es que abrir sus modelos podría exponerlos a mal uso, degradar la experiencia o incluso representar una amenaza para la integridad de los dispositivos.

Desde su punto de vista, mantener un entorno controlado les permite garantizar que su IA no será explotada para fines poco éticos ni causará daño a los usuarios. En una era marcada por los escándalos de privacidad y la desinformación, ese control puede verse como prudencia.

Sin embargo, desde fuera —y aquí entra otra parte de mi perspectiva— la decisión también huele a conservadurismo. Los avances de Apple en el campo de la IA generativa han sido bastante magros en comparación con los de sus competidores, y cerrarse al código abierto podría limitar aún más su capacidad de innovación colectiva.

Apertura controlada: lo que Apple realmente ofrece a desarrolladores

Aunque Apple no ha liberado sus modelos como open source, sí ha dado pasos estratégicos para “abrirse” parcialmente al mundo del desarrollo.

Tal como revela Bloomberg, Apple permitirá a los desarrolladores usar sus modelos de lenguaje mediante APIs, integrándolos en sus propias aplicaciones dentro del ecosistema Apple. Eso sí, con limitaciones estrictas: uso local, condiciones de revisión, y siempre dentro de los términos que Apple define.

Esto no es un movimiento menor. Es un intento de crear una economía de apps basada en IA, al estilo de su App Store, pero sin los riesgos del código abierto completo. Y aunque esta apertura no es absoluta, puede tener impacto.

Para los desarrolladores, representa una oportunidad concreta de trabajar con herramientas avanzadas sin tener que construir modelos desde cero. Para Apple, es una forma de capitalizar su enorme base de usuarios sin comprometer sus valores de control y privacidad.

Sin embargo, esta apertura también se percibe como una respuesta a la presión del mercado, más que como una convicción real de fomentar la innovación abierta. Es decir, no es una revolución; es una adaptación.

Comparativa: Apple vs Google vs Meta en el terreno de la IA abierta

Cuando se comparan las estrategias de IA entre las grandes tecnológicas, las diferencias son notables.

Meta apuesta por la comunidad: su modelo LLaMA ha sido publicado en múltiples versiones, permitiendo a investigadores y desarrolladores experimentar libremente. Este enfoque ha ganado tracción en el ámbito académico y en startups.

Google, con Gemini, ofrece un híbrido: modelos potentes disponibles a través de APIs, pero también con documentación pública, y con una hoja de ruta clara hacia herramientas accesibles y con integración en múltiples productos (Docs, Gmail, Android, etc.).

Apple, en cambio, se mueve en un terreno mucho más cerrado. Aunque abre las puertas a desarrolladores mediante APIs, no ofrece ni la transparencia ni la posibilidad de modificar sus modelos. Ni siquiera publica detalles técnicos extensos sobre los mismos.

Desde mi experiencia, este enfoque le resta protagonismo a Apple en la conversación sobre IA generativa. Mientras Google y Meta generan comunidad e impulsan avances colectivos, Apple opta por mantener el control absoluto. Eso tiene ventajas en seguridad, pero puede convertirse en un freno para la innovación.

¿Realmente Apple va por detrás en IA generativa?

La respuesta breve es sí, aunque con matices.

Apple lleva años utilizando IA en productos como el reconocimiento facial, la fotografía computacional y Siri. Sin embargo, cuando hablamos de IA generativa —modelos de lenguaje grandes, generación de texto, de imágenes, etc.— la compañía va claramente rezagada.

Microsoft, con OpenAI, ha liderado la carrera en integración rápida y profunda. Google ha respondido con Gemini. Meta, con LLaMA, ha apostado por el open source. Frente a esto, la introducción de Apple Intelligence no ha sido la revolución que se esperaba.

El problema no es solo de marketing. Es técnico. Los modelos de Apple aún no demuestran el nivel de sofisticación de sus competidores. Y aunque la empresa promete que la privacidad y la integración local marcan la diferencia, el usuario común percibe menos magia y más restricción.

Dicho esto, Apple tiene una ventaja única: el control total de hardware, software y distribución. Si logra mejorar sus modelos y abrirlos de forma más flexible a desarrolladores, aún tiene posibilidad de igualar —o incluso superar— a sus rivales. Pero tiene que moverse más rápido.

Privacidad, seguridad y el enfoque cerrado de Apple

Uno de los argumentos más sólidos de Apple es su enfoque en la privacidad. Apple Intelligence no solo funciona en la nube, sino también —y en gran medida— en el dispositivo. Es decir, los datos no salen del iPhone o Mac sin el consentimiento del usuario.

Esto contrasta con las soluciones cloud-first de otras compañías, y sin duda representa una gran ventaja en términos de confianza del usuario. Apple incluso ha integrado ChatGPT en su sistema, pero de forma opcional y siempre bajo supervisión del usuario.

Aquí hay una jugada inteligente. Al mantener el control, Apple evita escándalos de datos, minimiza riesgos regulatorios y puede diferenciarse con una propuesta de IA “segura por diseño”.

No obstante, la gran paradoja es que ese mismo control que protege la privacidad también limita la innovación. Los modelos no evolucionan tan rápido, los desarrolladores tienen menos espacio para experimentar, y los usuarios reciben funcionalidades menos impresionantes.

El equilibrio entre seguridad y apertura es difícil, pero Apple lo ha resuelto claramente en favor de la primera.

¿Qué impacto tiene esto para usuarios y desarrolladores?

Para el usuario común, el impacto de Apple Intelligence será tangible pero limitado. Recibirá mejoras automáticas en sus apps, un Siri más útil, y algunas funciones de productividad mejoradas. Pero no experimentará la misma sensación de “nueva era” que ofrecen otras IA más abiertas.

Para los desarrolladores, la historia es diferente. Tener acceso a modelos de Apple puede abrir muchas oportunidades, sobre todo si logran integrar IA en apps existentes o crear nuevas soluciones nativas para el ecosistema. Pero estarán siempre bajo la supervisión y limitaciones de Apple.

Desde el punto de vista estratégico, Apple busca construir un ecosistema autocontenido de IA, donde todo esté optimizado, controlado y supervisado. Puede funcionar, pero también puede aislar a la compañía del resto del avance colectivo que se está dando en el mundo de la IA abierta.

Mi percepción personal, como alguien que ha seguido de cerca estos movimientos, es que Apple aún no ha encontrado el ritmo adecuado para competir en este espacio. Y aunque su estrategia tiene lógica desde su ADN corporativo, quizás haya llegado el momento de abrir un poco más la puerta.

Conclusión: el futuro de la inteligencia artificial según Apple

Apple está jugando una partida distinta en el juego de la IA generativa. Su estrategia se basa en tres pilares: privacidad, integración profunda en su ecosistema, y una apertura parcial y controlada para desarrolladores.

No apuesta por el código abierto. No se lanza a la carrera sin tener el terreno bien asegurado. Y aunque eso le da ventaja en seguridad, también le resta velocidad en innovación y visibilidad en la comunidad global de desarrolladores.

Desde mi experiencia, Apple ha quedado un paso atrás en esta revolución. Pero tiene los recursos, la infraestructura y la base de usuarios necesaria para recuperar terreno.

Todo dependerá de si está dispuesta a ceder algo de control para ganar relevancia. Y de si sus modelos de IA realmente logran sorprender en próximas iteraciones. Porque si algo ha demostrado el mundo de la inteligencia artificial, es que la colaboración, la apertura y la velocidad lo son todo.

Publicar comentario