IA que analiza tu pantalla en Windows: una revolución para programar y diseñar

¿Y si tu computadora pudiera “ver” lo que haces y ayudarte justo cuando lo necesitas? Suena a ciencia ficción, pero ya está ocurriendo. La nueva generación de inteligencia artificial no solo responde preguntas, sino que observa tu entorno digital, lo interpreta y colabora contigo en tiempo real. Hablamos de asistentes IA visuales como Copilot Vision capaces de analizar lo que ves en pantalla y ayudarte a programar, diseñar o automatizar tareas complejas.

Este artículo es una guía completa para entender cómo estas herramientas están cambiando el juego. Te mostraré las mejores opciones disponibles para Windows, cómo instalar modelos locales sin depender de la nube, y te contaré mi experiencia real usando este tipo de IA todos los días para trabajar de forma más inteligente.

¿Qué es un copiloto visual y cómo funciona en Windows?

Un copiloto visual es una inteligencia artificial que tiene la capacidad de ver tu pantalla y ofrecerte asistencia contextual en tiempo real. A diferencia de los tradicionales asistentes de voz o chat, esta IA analiza visualmente tu entorno digital: el código que estás escribiendo, el diseño que estás editando, los documentos que abres, e incluso los errores que aparecen en tiempo real.

Su funcionamiento se basa en modelos de visión artificial (como CLIP o GPT-4V) que son capaces de interpretar lo que ven combinando imagen y texto. En entornos Windows, estos copilotos pueden integrarse como una aplicación flotante, una barra lateral o incluso funcionar desde el icono del sistema tray.

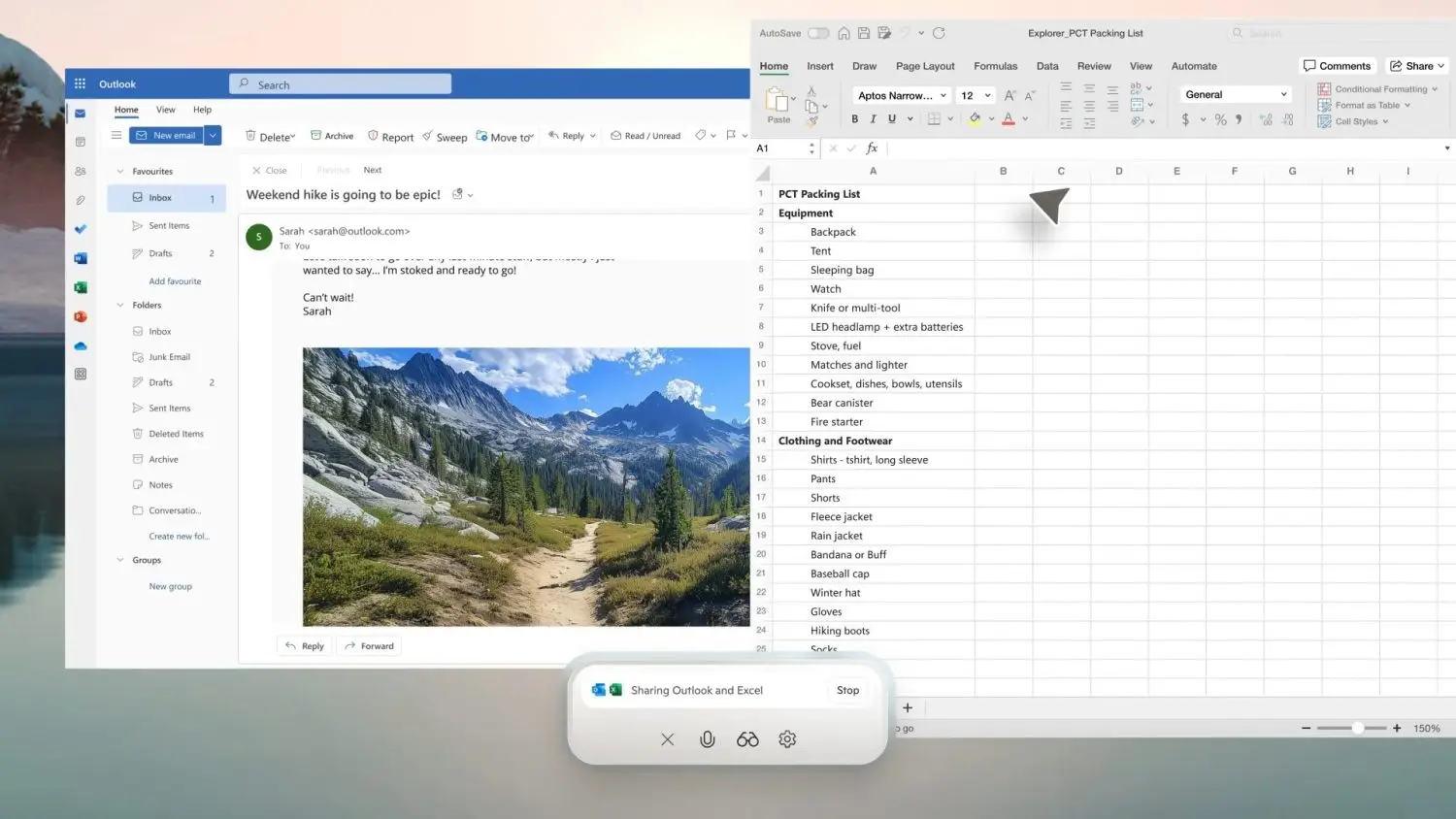

En el caso de Copilot Vision de Microsoft, por ejemplo, la IA puede tomar una captura de pantalla de tu escritorio, identificar el entorno de desarrollo (VS Code, por ejemplo), ver qué línea de código estás editando y sugerirte correcciones o incluso bloques completos de código.

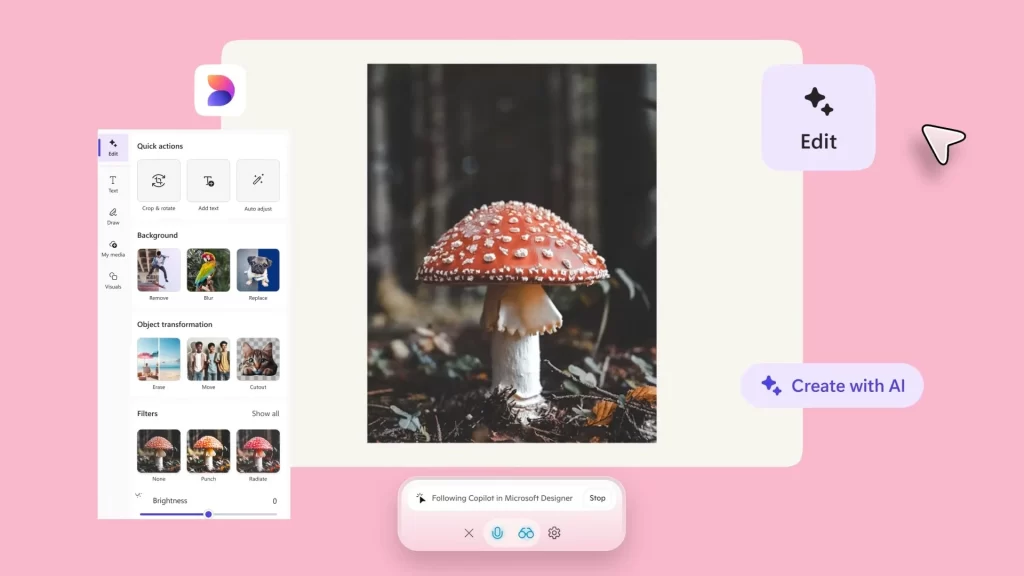

Lo mismo se aplica a tareas de diseño: puede analizar los elementos visuales de tu interfaz en Figma, Photoshop o Canva, y proponerte alternativas, alineaciones o ideas de color basadas en buenas prácticas de UX.

🧠 ¿Qué necesitas?

- Un sistema Windows actualizado (idealmente Windows 11).

- Acceso a herramientas como Copilot Vision (o instalar modelos IA locales).

- Permisos de captura de pantalla y acceso a teclado/ratón (para contextualizar tus acciones).

💡 Lo más potente de todo esto es que no se limita a darte respuestas… actúa como un verdadero colaborador que entiende qué estás haciendo y te guía paso a paso.

✅ Avanzo ahora con la siguiente sección:

Las mejores herramientas de IA para escritorio que puedes instalar hoy.

Las mejores herramientas de IA para escritorio que puedes instalar hoy

Cuando se trata de tener un asistente IA que funcione directamente desde tu PC, tienes dos caminos: usar soluciones ya integradas como Copilot Vision de Microsoft o instalar modelos de IA locales por tu cuenta. Ambas opciones tienen ventajas, y todo depende de tu nivel técnico y el tipo de tareas que quieras automatizar.

Aquí te dejo un listado con las opciones más interesantes para usuarios que quieren trabajar con IA que analiza su pantalla y los asiste en tiempo real.

1. Copilot Vision (Microsoft)

Este es el asistente nativo más reciente para Windows 11. Tiene la capacidad de “ver” tu pantalla, identificar el contexto y ayudarte con sugerencias precisas. Desde escribir código hasta explicarte interfaces complejas, es un copiloto visual en toda regla.

- Integración total con Windows.

- Acceso a tus apps abiertas.

- Recomendaciones contextualizadas.

- Gratuito (por ahora) en versión preliminar.

🔒 Requiere conexión a Internet y tiene limitaciones en privacidad.

2. DeepSeek + Open Interpreter

DeepSeek es un modelo de lenguaje potente y gratuito. Combinado con herramientas como Open Interpreter, puede actuar como copiloto local: accede a tu pantalla, teclado y mouse (si lo permites) y ejecuta comandos o edita código automáticamente.

- Se ejecuta en tu máquina (máxima privacidad).

- Usa Python para automatizar acciones.

- Muy personalizable con scripts propios.

- Requiere conocimientos técnicos para configurar.

🔧 3. LLaMA / Mistral / Gemma con GPT4All o LM Studio

Si prefieres modelos locales que no dependan de la nube, esta es la ruta. Puedes correr modelos como LLaMA 3, Mistral o Gemma en tu PC con aplicaciones como LM Studio o GPT4All.

- Funcionan offline.

- Soporte para análisis de pantalla con plugins de OCR.

- Posibilidad de entrenar tu propia lógica.

- Más rápidos y económicos que soluciones cloud.

🧪 Mi experiencia personal:

Yo mismo he instalado DeepSeek y Mistral en mi PC usando LM Studio. Al principio fue algo técnico, pero una vez configurado, la sensación de tener una IA que responde en segundos a lo que aparece en mi pantalla (sin depender de Internet) es simplemente alucinante.

⏭️ En la siguiente sección te explicaré cómo instalar estos modelos IA locales, incluso si no eres un experto en desarrollo. ¡Vamos allá!

¿Cómo instalar modelos de IA locales como DeepSeek, LLaMA o Mistral?

Instalar modelos de inteligencia artificial en tu PC ya no es cosa de ingenieros. Con las herramientas adecuadas, puedes tener tu propio asistente IA local funcionando en minutos. Aquí te explico paso a paso cómo hacerlo, usando DeepSeek y LLaMA como ejemplos, y sin necesidad de conocimientos avanzados en programación.

Paso 1: Descarga e instala LM Studio o GPT4All

Estas aplicaciones actúan como “lanzadores” de modelos de lenguaje. LM Studio, por ejemplo, te permite descargar modelos como LLaMA 3 o Mistral con solo un clic y ejecutarlos directamente desde tu escritorio.

- Visita lmstudio.ai o gpt4all.io

- Descarga la app para Windows.

- Instálala y ejecuta.

Ambas aplicaciones detectan automáticamente si tu PC tiene GPU para acelerar el modelo. Pero funcionan bien incluso en CPU.

Paso 2: Elige tu modelo IA

Una vez dentro de la app, puedes explorar una lista de modelos disponibles. Te recomiendo empezar con:

- DeepSeek Coder (si te interesa programar)

- Mistral 7B (rápido y preciso)

- LLaMA 3 8B (más potente, ideal si tienes buena RAM)

Haz clic en “descargar” y el modelo se instalará localmente.

Paso 3: Activa el análisis de pantalla

Algunos lanzadores como GPT4All o scripts con Open Interpreter permiten acceder a la pantalla (captura visual), teclado y mouse. Esto permite que la IA vea literalmente lo que estás haciendo.

💡 En mi caso, utilicé Open Interpreter en combinación con DeepSeek. Le otorgué permiso para capturar pantalla y ahora detecta automáticamente si estoy escribiendo código, qué error aparece, o incluso qué estructura tiene el diseño que estoy viendo.

Paso 4: Personaliza tus comandos

Uno de los grandes beneficios de tener la IA local es que puedes crear tus propias automatizaciones. Por ejemplo:

- “Corrige este código”

- “Resume lo que hay en pantalla”

- “Rediseña esta estructura con CSS moderno”

- “Explícame esta interfaz de usuario”

Después de experimentar con varios modelos, encontré que DeepSeek combinado con visión de pantalla es increíblemente útil. He corregido funciones de Python, mejorado estructuras HTML, y ajustado diseños CSS directamente con sugerencias generadas por la IA al ver mi pantalla.

Aplicaciones prácticas: desde corregir código hasta diseñar interfaces

Una vez que tienes un modelo IA local o un copiloto visual como Copilot Vision activo, las posibilidades se disparan. Ya no se trata solo de hacer preguntas; ahora puedes mostrarle a tu IA lo que estás haciendo y obtener ayuda inmediata, sin cambiar de ventana ni copiar y pegar.

Aquí te muestro los usos más impactantes que he explorado personalmente en el día a día de programación y diseño.

👨💻 Para programadores

- Depuración en tiempo real

La IA detecta errores visibles en la pantalla (como mensajes en la consola o IDE) y te propone soluciones directamente. En mi caso, cada vez que aparece un “Traceback” en Python, DeepSeek detecta el error, lo analiza y me sugiere cómo arreglarlo, con el código corregido listo para copiar. - Autocompletado visual

¿Tienes una estructura HTML abierta? El copiloto puede verla y completarla con estilos CSS, etiquetas faltantes o incluso optimizaciones para SEO. - Documentación al instante

Con solo seleccionar una función o clase, la IA puede documentarla en segundos con formato docstring, comentarios o hasta generar README completo si ve tu repositorio en pantalla.

🎨 Para diseñadores

- Revisión de layouts

Abro un diseño en Figma o Canva, y la IA analiza si los márgenes son coherentes, propone ajustes de alineación o detecta inconsistencias visuales. Incluso me sugiere paletas de color más armónicas si detecta un desbalance visual. - Generación de texto alternativo

Viendo las imágenes o elementos de la interfaz, la IA genera automáticamente textos alternativos o descripciones accesibles (muy útil para diseño inclusivo). - Optimización UX

Si muestro un formulario o estructura interactiva, puede sugerir mejores distribuciones o flujos de navegación, basados en patrones comunes de usabilidad.

En un proyecto reciente, diseñé una app tipo dashboard. Mostré la interfaz al modelo y me sugirió mejoras visuales como distribuir mejor los datos, usar color de acento más consistente y añadir etiquetas accesibles. Además, cuando codifiqué los componentes en React, la IA detectó funciones redundantes y las optimizó.

Ventajas (y desafíos) de tener un asistente IA que “mira” tu pantalla

Tener una inteligencia artificial que analiza lo que haces en tu PC suena increíble, pero también plantea algunas preguntas importantes. En esta sección te muestro los beneficios más notables, así como los retos y limitaciones que debes tener en cuenta antes de lanzarte de lleno.

✅ Ventajas claras

1. Productividad instantánea

No necesitas explicar qué estás haciendo: la IA lo ve y actúa. Esto reduce el tiempo de espera, evita errores de interpretación y te da soluciones en segundos.

2. Personalización y autonomía

Con modelos locales como Mistral o DeepSeek, puedes ajustar los comportamientos del asistente. Yo, por ejemplo, configuré scripts para que me sugiriera nombres de variables consistentes y me alertara cuando olvido cerrar funciones o tags HTML.

3. Privacidad total (con modelos locales)

Al ejecutar IA en tu propio equipo, los datos nunca salen de tu computadora. Ideal si trabajas con proyectos sensibles, código privado o información confidencial.

4. Multitarea real

La IA puede detectar lo que haces en distintas apps a la vez: mientras programas en VS Code y tienes Figma o tu navegador abierto, va captando contexto de todos ellos.

⚠️ Desafíos importantes

1. Requisitos de hardware

Modelos como LLaMA o Mistral pueden requerir entre 8 y 16 GB de RAM para funcionar fluidamente. Si no tienes buena máquina, puede ralentizar tu flujo.

2. Configuración inicial técnica

Instalar y afinar modelos locales como DeepSeek o usar Open Interpreter requiere algo de paciencia. La curva de aprendizaje no es para todos.

🧪 A mí me tomó un par de días ajustar bien el acceso al sistema de captura de pantalla y establecer los comandos personalizados. Pero una vez superado ese muro, la experiencia es fluida.

3. Privacidad con copilotos en la nube

Herramientas como Copilot Vision requieren acceso completo a tu pantalla y envían datos a la nube. Esto puede ser un problema si manejas contenido privado o sensible.

4. Falta de regulación y transparencia

Los copilotos visuales aún están en desarrollo, y muchas veces sus decisiones no son del todo explicables. A veces sugiere soluciones válidas, pero sin dejar claro el razonamiento.

📌 ¿Recomendación?

Empieza con un modelo local sencillo (como Mistral 7B) y ve ampliando funciones poco a poco. Si usas Copilot Vision, limítalo a tareas donde no haya datos sensibles. Así combinas lo mejor de ambos mundos.

⏭️ Vamos ahora con una comparativa directa entre Copilot Vision y los modelos IA locales.

¿Copilot Vision o IA local? Comparativa real para usuarios avanzados

Una de las preguntas que más se repite cuando alguien se interesa en tener una IA que analice su pantalla es: ¿debo usar algo como Copilot Vision o instalar mi propia IA local como Mistral o DeepSeek? La respuesta depende de tus necesidades, pero aquí te dejo una comparativa clara basada en mi experiencia real.

Copilot Vision: Lo bueno y lo no tanto

Ventajas:

- Instalación inmediata en Windows 11.

- Interfaz amigable y lista para usar.

- Accede a todas tus ventanas activas sin configuración adicional.

- Ideal para tareas rápidas de programación o corrección visual.

Desventajas:

- Requiere conexión permanente a Internet.

- Envía datos a la nube (no recomendado para trabajos sensibles).

- Opciones limitadas de personalización.

- Aún en desarrollo, puede fallar en tareas complejas o específicas.

Modelos IA Locales (DeepSeek, LLaMA, Mistral)

Ventajas:

- Máximo control: tú decides qué modelo usar y cómo configurarlo.

- No hay filtrado de datos: todo ocurre dentro de tu máquina.

- Puedes personalizar comandos, integrar APIs, hacer automatizaciones a medida.

- Rendimiento estable y sin necesidad de conexión.

Desventajas:

- Requiere conocimientos técnicos para instalar y ajustar.

- Pide bastante memoria RAM y buen procesador (mínimo 8 GB, ideal 16+).

- La interfaz suele ser más técnica (scripts, terminal, configuraciones YAML).

🧪 En mi caso, empecé con Copilot Vision y me pareció alucinante… hasta que quise personalizar más. Al instalar DeepSeek localmente, noté mejoras enormes: podía analizar interfaces, generar CSS, explicar errores y ejecutar acciones específicas sin tener que copiar nada. Todo dentro de mi flujo de trabajo, sin latencia ni riesgos de privacidad.

📊 Comparativa rápida

| Característica | Copilot Vision | Modelos Locales IA |

|---|---|---|

| Instalación | Muy fácil | Requiere conocimientos |

| Privacidad | Baja (usa la nube) | Alta (todo local) |

| Personalización | Limitada | Total |

| Requiere Internet | Sí | No |

| Requisitos técnicos | Bajos | Medios-altos |

| Tiempo de respuesta | Bueno (pero con latencia) | Instantáneo (depende del equipo) |

| Casos de uso | Generalistas | Especializados, personalizables |

⏭️ Cerramos con una conclusión que resume todo este viaje.

Conclusión: el futuro de la programación y el diseño pasa por tu escritorio

Estamos ante una transformación radical. Las inteligencias artificiales ya no son solo chatbots inteligentes, sino copilotos visuales que ven lo que tú ves en pantalla, entienden el contexto y actúan contigo, como un compañero de trabajo que no duerme, no se distrae y no necesita explicaciones largas.

Durante los últimos meses, he probado diferentes herramientas, desde Copilot Vision hasta DeepSeek y Mistral, y la conclusión es clara: la IA visual en el escritorio es una de las innovaciones más potentes y útiles que hemos visto. No solo me ha ayudado a depurar código más rápido, sino que me ha sugerido soluciones de diseño, corregido errores visuales, explicado interfaces complejas y automatizado tareas que antes me tomaban horas.

El poder de instalar modelos locales que trabajan sin conexión y con privacidad total es un punto de inflexión. Ya no dependemos de servidores externos ni de permisos dudosos. Ahora tú decides qué hace la IA, cómo lo hace y en qué momento.

¿Qué deberías hacer ahora?

- Explora: empieza por probar Copilot Vision si quieres una experiencia directa y sin complicaciones.

- Instala: si tienes algo de experiencia técnica, ve a por LM Studio o GPT4All y prueba con Mistral o DeepSeek.

- Experimenta: haz que la IA vea tu pantalla. Prueba a enseñarle código, diseños, documentos… y observa lo que puede hacer.

- Adapta: personaliza tus comandos, crea tus propios flujos y convierte tu PC en un entorno de colaboración IA real.

La inteligencia artificial que analiza tu pantalla ya no es el futuro. Es el presente, y está a un clic de distancia. Si sabes cómo usarla, se convierte en tu mejor aliada para programar, diseñar y trabajar mejor que nunca.

🔧 Y lo más importante: está en tus manos decidir cómo aprovecharla. Porque ahora, tu escritorio es el centro de la revolución.

Publicar comentario