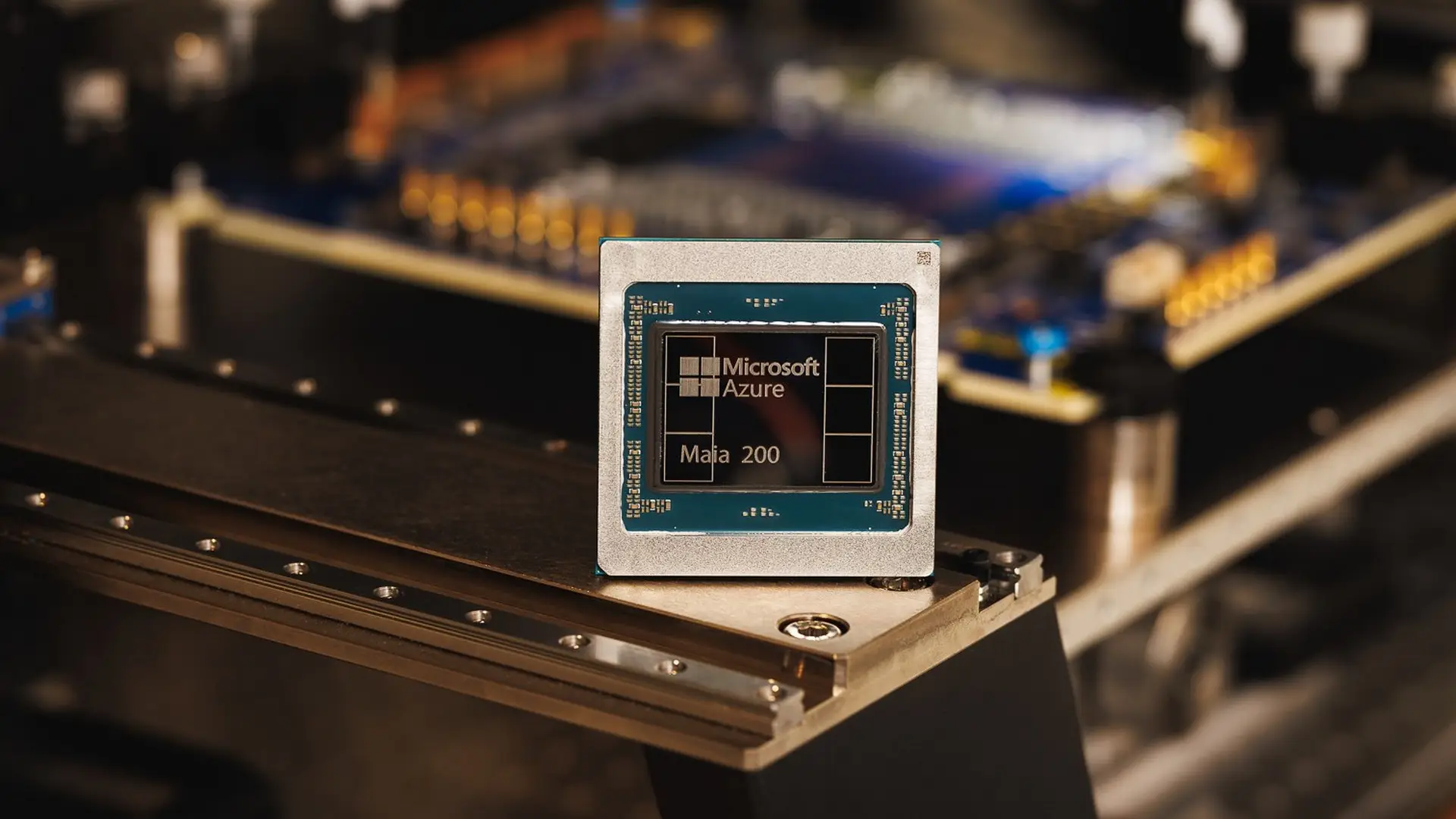

Microsoft Maia 200: así es el nuevo chip de IA con el que quiere competir con NVIDIA y Google

Microsoft ha presentado Maia 200, su nuevo chip de inteligencia artificial diseñado específicamente para centros de datos. Más allá del anuncio, este movimiento deja clara una cosa: la compañía quiere reducir su dependencia de terceros y plantar cara directamente a NVIDIA, Google y Amazon en el terreno del hardware de IA.

En mi caso, lo que más me llamó la atención no fue solo el lanzamiento en sí, sino el contexto. Maia 200 no es un experimento aislado, sino la evolución lógica del Maia 100 presentado en 2023, lo que indica una estrategia clara y sostenida por parte de Microsoft.

Qué es Maia 200 y para qué sirve

Maia 200 es un acelerador de IA desarrollado por Microsoft para ejecutar cargas de trabajo de inteligencia artificial a gran escala. No es un chip pensado para ordenadores personales ni para venderse al público: su destino son los centros de datos de Azure.

Un acelerador de IA pensado para inferencia

El foco principal de Maia 200 está en la inferencia, es decir, en ejecutar modelos de IA ya entrenados de la forma más eficiente posible. Según la propia Microsoft, este nuevo chip ofrece hasta un 30 % más de rendimiento frente a su predecesor en este tipo de tareas.

Esto encaja perfectamente con el uso real de la IA hoy en día. Cuando probé y analicé cómo funcionan los servicios de IA a gran escala, queda claro que el mayor coste no está solo en entrenar modelos, sino en ejecutarlos millones de veces al día para usuarios reales.

De Maia 100 a Maia 200: evolución del chip de Microsoft

Maia 200 llega como reemplazo directo del Maia 100, presentado apenas un año antes. Este detalle es clave, porque demuestra que Microsoft no está improvisando.

El Maia 100 sirvió como primera toma de contacto con el silicio propio para IA. Maia 200, en cambio, apunta a:

- Mayor eficiencia energética

- Mejor rendimiento en inferencia

- Integración más profunda con la infraestructura de Azure

Desde fuera, se percibe como un paso lógico: probar, medir resultados y mejorar rápidamente. Exactamente la misma filosofía que Microsoft ha aplicado en otros frentes tecnológicos.

Por qué Maia 200 es clave en la estrategia de Microsoft

Este chip no existe por capricho. Forma parte de una estrategia mucho más amplia.

Centros de datos, Azure y escalado de IA

Microsoft opera algunos de los mayores centros de datos del mundo. Depender exclusivamente de NVIDIA o de soluciones externas limita costes, escalado y optimización. Con Maia 200, la empresa gana:

- Control sobre su hardware

- Optimización específica para sus servicios

- Menor dependencia de proveedores externos

En mi opinión, este punto es fundamental. No se trata de “crear un chip mejor”, sino de crear un chip perfectamente adaptado a lo que Microsoft necesita para escalar IA en Azure.

Maia 200 frente a NVIDIA, Google y Amazon

La comparación es inevitable.

- NVIDIA domina el mercado con sus GPU para IA

- Google lleva años desarrollando sus TPU

- Amazon apuesta por Trainium e Inferentia

Maia 200 no pretende destronar a NVIDIA en el corto plazo, pero sí ofrece a Microsoft una alternativa interna real. Cuando observas el movimiento en conjunto, queda claro que todos los grandes actores están siguiendo el mismo camino: diseñar su propio hardware para IA.

En este sentido, Maia 200 coloca a Microsoft al mismo nivel estratégico que sus principales competidores.

Qué impacto puede tener en ChatGPT y los servicios de IA

Uno de los puntos más interesantes es su relación indirecta con ChatGPT y los servicios de OpenAI integrados en Azure.

Al centrarse en inferencia, Maia 200 puede:

- Reducir costes por consulta

- Mejorar tiempos de respuesta

- Facilitar el despliegue masivo de modelos

Desde mi punto de vista, este tipo de mejoras son invisibles para el usuario final, pero críticas para la sostenibilidad de servicios de IA a gran escala.

Qué podemos esperar del futuro de los chips de IA de Microsoft

Maia 200 no será el último. Todo apunta a que Microsoft seguirá iterando y mejorando su silicio propio, igual que han hecho Google y Amazon.

Si el rendimiento y la eficiencia cumplen lo prometido, es razonable pensar que veremos:

- Nuevas versiones de Maia

- Mayor independencia tecnológica

- IA más integrada y optimizada en Azure

Más que competir por titulares, Microsoft parece estar jugando una partida a largo plazo.

Conclusión

Maia 200 no es solo “otro chip de IA”. Es una pieza estratégica que refuerza la posición de Microsoft en la carrera por dominar la infraestructura de inteligencia artificial. Al centrarse en inferencia, centros de datos y servicios reales, la compañía demuestra que entiende dónde está el verdadero cuello de botella de la IA actual.

Si el Maia 100 fue una prueba, Maia 200 es una declaración de intenciones.

FAQs sobre Microsoft Maia 200

¿Qué es el chip Maia 200 de Microsoft?

Es un acelerador de IA diseñado para centros de datos, enfocado principalmente en tareas de inferencia.

¿En qué mejora al Maia 100?

Ofrece hasta un 30 % más de rendimiento en inferencia y una mejor integración con Azure.

¿Compite directamente con NVIDIA?

Sí, aunque su objetivo principal es reducir la dependencia interna más que dominar el mercado externo.

¿Dónde se utiliza Maia 200?

En los centros de datos de Microsoft, especialmente dentro de Azure.

¿Tiene relación con ChatGPT?

Indirectamente sí, ya que puede optimizar la ejecución de modelos usados por servicios de IA como ChatGPT.

Publicar comentario